أثارت أحدث مشكلة تتعلق بالذكاء الاصطناعي في Canva تساؤلات جديدة حول مدى موثوقية أدوات التصميم التوليدي، تواجه منصة التصميم الشهيرة انتقادات حادة بعد أن اكتشف المستخدمون أن إحدى ميزات الذكاء الاصطناعي الجديدة تستبدل كلمة "فلسطين" تلقائيًا بكلمة "أوكرانيا" داخل التصاميم، ما كان من المفترض أن يكون مجرد أداة تحرير بسيطة، سرعان ما تحول إلى نقاش واسع النطاق حول التحيز، والرقابة، وكيف تتخذ أنظمة الذكاء الاصطناعي قرارات غير متوقعة.

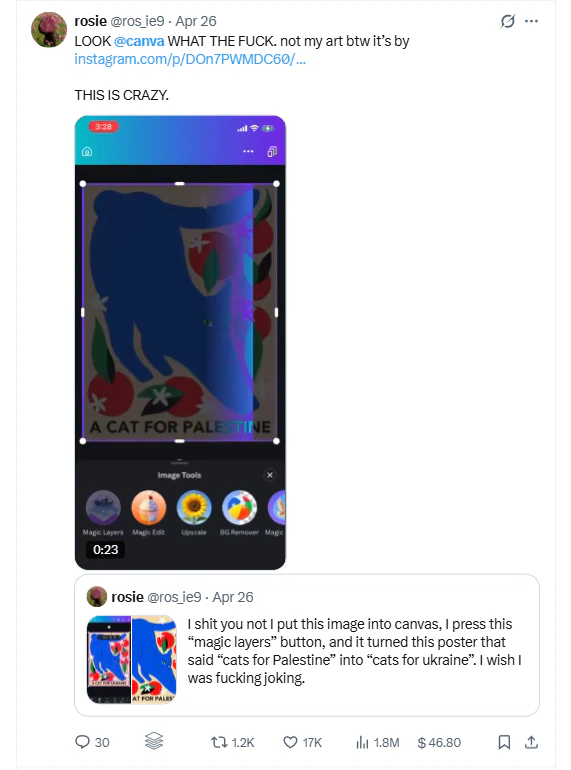

أشار المستخدم @ros_ie9 على منصة X إلى هذه المشكلة لأول مرة، حيث شارك لقطات شاشة تُظهر ميزة "الطبقات السحرية" في Canva وهي تُغير عبارة "قطط من أجل فلسطين" إلى "قطط من أجل أوكرانيا"، انتشر المنشور بسرعة على الإنترنت، وتساءل العديد من المستخدمين عن سبب قيام الأداة بتغيير النصوص، خاصةً دون أي طلب من المستخدم.

جدل واسع بعد خطأ في ميزة Magic Layers

"الطبقات السحرية" هي إحدى أدوات الذكاء الاصطناعي التي أطلقتها Canva مؤخرًا، وهي مصممة لفصل الصور المسطحة إلى طبقات قابلة للتحرير، مما يُسهل على المستخدمين تعديل أجزاء التصميم بشكل فردي، ببساطة، يُفترض أن تُساعد هذه الميزة في فصل النصوص والرسومات والعناصر من الصورة النهائية، ما يُتيح تعديلها بشكل منفصل، وهي ليست مُخصصة لإعادة صياغة الكلمات أو استبدال المصطلحات السياسية.

ما زاد الأمر غرابةً هو أن المشكلة بدت محصورةً بكلمة "فلسطين"، فبحسب المستخدمين الذين جرّبوا الميزة، لم تتغير كلمات مثل "غزة"، وادّعى بعض المُعلّقين على المنشور المُنتشر أنهم تمكّنوا من إعادة إنتاج النتيجة نفسها قبل أن تُصدر Canva تحديثًا لإصلاح المشكلة.

اعتذرت Canva بعد ما فعلته أداة الذكاء الاصطناعي

مع تزايد الانتقادات، ردّت Canva باعتذار، مُعلنةً حلّ المشكلة، وصرح مُتحدث باسم الشركة لموقع The Verge: "علمنا بوجود مشكلة في ميزة Magic Layers، وسارعنا إلى التحقيق فيها وإصلاحها"، وأضافت Canva أن المشكلة قد حُلّت الآن، ويجري اتخاذ الإجراءات اللازمة لمنع تكرار أي شيء مماثل.

وأضاف المتحدث الرسمي: "نتعامل مع مثل هذه التقارير بجدية بالغة، ونعمل على وضع إجراءات تدقيق إضافية لمنع تكرارها مستقبلاً، نأسف لأي إزعاج قد يكون سببه هذا الأمر".

وأكدت كانفا أن المشكلة معزولة ولم تؤثر على التصاميم بشكل عام، مع ذلك، لم توضح الشركة بشكل كامل كيفية حدوث تبديل الكلمات، كما لا يزال من غير الواضح ما إذا كان الخطأ ناتجًا عن بيانات التدريب، أو فلاتر الإشراف الداخلية، أو نظام آلي آخر يعمل في الخفاء.

يُعد هذا السؤال الذي لم تتم الإجابة عليه محور الجدل الدائر، يتساءل العديد من المستخدمين عن سبب قيام ميزة مصممة لتحرير طبقات الصور بتغيير محتوى النص بشكل مستقل، غالبًا ما يشير الخبراء إلى أن أنظمة الذكاء الاصطناعي قد تتصرف أحيانًا بشكل غير متوقع نظرًا لضخامة مجموعات البيانات والقواعد المستخدمة في تدريبها، ومع ذلك، عندما تمس مثل هذه الأخطاء مواضيع جيوسياسية حساسة، تتفاقم التداعيات بشكل كبير.

يُعد التوقيت أيضًا غير مناسب لكانفا، حيث تعمل الشركة على توسيع عروضها في مجال الذكاء الاصطناعي بقوة لمنافسة أدوبي وشركات برامج التصميم الأخرى بشكل مباشر، تُعد "الطبقات السحرية" جزءًا من حملة أوسع للذكاء الاصطناعي روّجت لها كانفا مؤخرًا باعتبارها المرحلة التالية في صناعة المحتوى، بدلاً من أن تُبرز هذه الأداة الابتكار، باتت الآن موضع تدقيق بسبب خطأ فادح.

وهذه ليست المرة الأولى التي تواجه فيها منصة ذكاء اصطناعي اتهامات بالتحيز فيما يتعلق بالرسائل المتعلقة بفلسطين، ففي حالات سابقة، وُجهت انتقادات لشركات تقنية أخرى بسبب مخرجات إشكالية تتعلق بتوليد الصور واستخدام لغة سياسية، كل حادثة جديدة تُفاقم المخاوف من احتمال وجود تحيزات خفية في أنظمة الذكاء الاصطناعي، سواءً في البيانات التي تتعلم منها أو في القواعد المُبرمجة لها.

0 تعليق